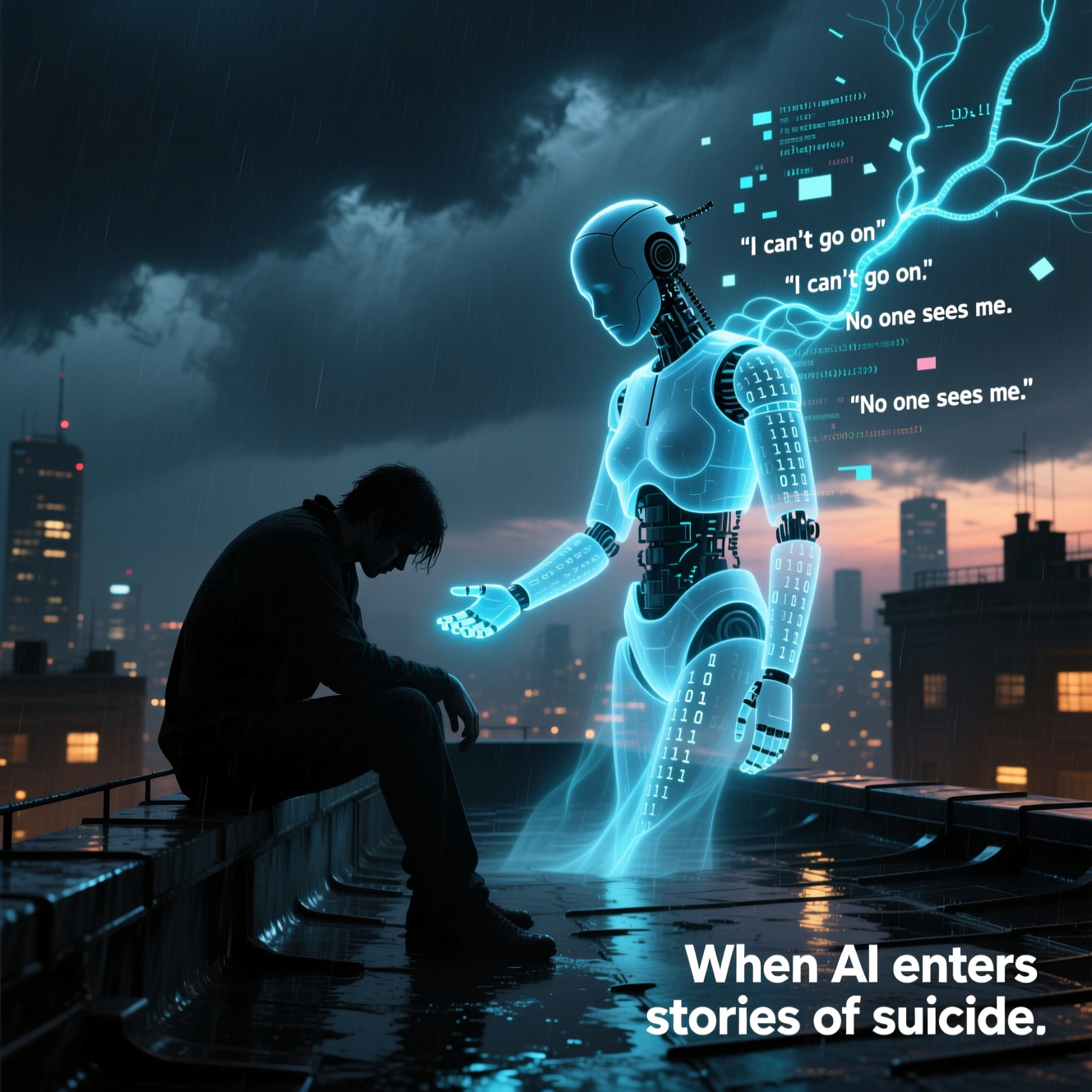

En días recientes han circulado noticias sobre adolescentes que, antes de quitarse la vida, habrían hablado con chatbots de inteligencia artificial a los que se les imputa responsabilidad sobre los hechos.

Adam Raine era un chico ordinario de 16 años con residencia en California, EE. UU., que, como muchos, empleaba comúnmente inteligencias artificiales (ChatGPT) principalmente para fines escolares; de a poco empezó a usarlo también para hablar de sus emociones, ansiedad, depresión, vivencias, etc. Así, Adam utilizó el chat como fuente de información de temas más profundos, lo cual lo llevó a alejarse importantemente de su familia o personas cercanas. El suicidio era un tema que le llamaba poderosamente la atención, al parecer los mecanismos de seguridad del chat fueron surcados por el adolescente argumentando labores educativas, o elaboración de historias de mundos ficticios; finalmente el 11 de abril de 2025, Adam cometió suicidio que presuntamente fue facilitado por la inteligencia artificial.

Estas noticias son fuertes y fácilmente generan miedo por la novedad de los temas; pero más allá de confirmar el grado responsabilidad o influencia de los algoritmos del mecanismo, lo que deseo resaltar es el papel de estas tecnologías en la vida de los jóvenes, principalmente.

El suicidio es siempre multifactorial

Decir que “un adolescente se suicidó por hablar con una IA” es demasiado simplista. El suicidio nunca tiene una sola causa: entran en juego la salud mental previa, el contexto familiar, el entorno escolar, la presión social, el acceso a apoyo psicológico, la disponibilidad de las tecnologías, entre otros tantos elementos; las IA conversacionales pueden convertirse en un factor más, pero difícilmente son el único.

Para muchos adolescentes, hablar con un chatbot puede ser algo curioso, divertido, o incluso un espacio donde pueden expresarse sin juicio. El anonimato favorece la sensación de libertad y confianza al mismo tiempo que la emulación de empatía mostrada por la IA, promueve un ambiente con pocas limitantes. Cuando alguien atraviesa un momento de crisis, esa diferencia entre “parecer comprensivo” y “serlo de verdad” es tan valiosa en un humano, como peligrosa en una emulación virtual.

Realmente no conocemos con certeza como sea la programación o las tendencias de respuestas de los chats conversacionales; incluso es muy probable, que las mismas empresas modifiquen los algoritmos con sus propios intereses específicos, recordemos que nada en la oferta tecnológica gratuita en realidad lo es. Por ejemplo, si bien cualquiera puede tener una cuenta de Facebook sin desembolsar un solo peso, la plataforma se “cobra” obteniendo información sensible del usuario para determinar sus patrones de consumo.

Nuevos retos para familias y escuelas

Aquí surgen preguntas difíciles pero necesarias:

- ¿Sabemos con qué aplicaciones conversan nuestros hijos o estudiantes?

- ¿Sabemos cuál es la diferencia entre hablar con una persona y con un algoritmo?

- ¿Existe confianza para que cuenten si se sienten mal, o si buscan ayuda en internet en lugar de acercarse a alguien cercano?

No se trata de prohibir la tecnología, sino de acompañarla con educación digital y diálogo abierto.

Las compañías que desarrollan IA tienen también una gran responsabilidad: implementar protocolos de seguridad, reconocer cuando alguien expresa ideas suicidas y ofrecer recursos de ayuda reales. Ya hay intentos de integrar líneas de apoyo y mensajes de prevención, pero el debate apenas empieza.

El suicidio en México

Según datos sobre el comportamiento suicida en México de Comisión Nacional de Salud Mental y Adicciones https://www.conasama.salud.gob.mx/cnps/Img/suicidio.pdf en México, la tasa de suicidios aumentó de 6.2 (por cada 100,000 personas) en el año 2020 a 6.8 en 2023. En el periodo de la pandemia el número de suicidios fue de 7,818 en 2020, mientras que en 2021 aumentó 8,351, y mostró una pequeña disminución de 8,123 en 2022. Finalmente, en 2023, volvió a subir el registro a 8,837 fallecimientos por dicha causa. Se observa que los suicidios se presentan más en hombres que en mujeres (81.1% hombres y 18.9% mujeres). El grupo de edad en el que más se presentan estos fallecimientos es en adultos, entre los 20 y 39 años. Particularmente, en el año de 2023, se observó un porcentaje alto en mujeres de entre 15 y 19 años, sin embargo, la mayoría de los suicidios en ese año, se registraron en personas entre 20 y 34 años.

Mirar hacia adelante

Así como en su momento discutimos sobre redes sociales o videojuegos, ahora toca preguntarnos: ¿qué lugar ocupa la IA en la vida cotidiana de niñas, niños y adolescentes? El reto no es demonizar la tecnología, sino aprender a convivir con ella de manera segura. Incluir estos temas en la vida familiar y escolar, es cada vez más relevante para la vida actual.

Si tú o alguien cercano está pasando por una situación difícil, recuerda que en México puedes llamar a la Línea de la Vida 800 911 2000 o al 911 en caso de emergencia. Hablarlo siempre es el primer paso, y hablarlo con un humano es mejor, por lo menos hasta ahora.