En la era de la Inteligencia Artificial, nuestros ojos ya no son un filtro infalible. Desde bebés con voces de adultos hasta figuras públicas haciendo declaraciones imposibles, los deepfakes están erosionando la base de nuestra confianza en las noticias, las marcas y las interacciones diarias.

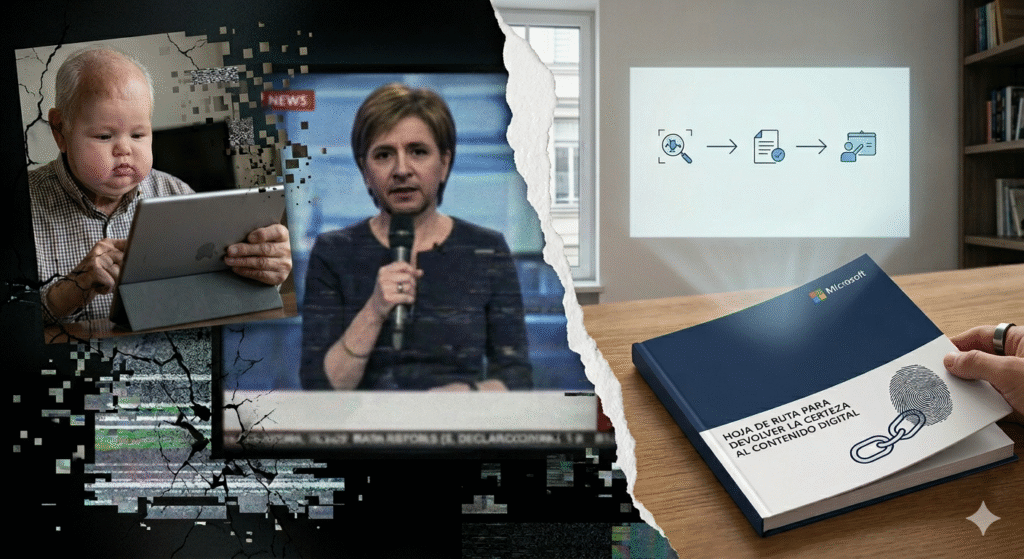

Microsoft ha publicado un informe exhaustivo titulado «Media Integrity and Authentication», donde traza una hoja de ruta para devolver la certeza al contenido digital.

1. El desafío: Cuando la IA supera la percepción humana

La motivación detrás de este estudio es clara: la IA generativa es cada vez más potente. Hoy es casi imposible distinguir entre un video capturado por una cámara real y un deepfake sofisticado.

- El dilema: Existe una necesidad urgente de verificar qué es real, pero las herramientas actuales tienen limitaciones.

- El objetivo: Informar a creadores, tecnólogos y legisladores sobre qué es posible hoy y cómo construir un futuro digital más seguro.

2. La solución: “Autenticación de Alta Confianza”

Los autores del informe concluyen que no existe una “bala de plata”. La solución reside en combinar varios métodos para mitigar las debilidades individuales de cada uno:

- La Procedencia (Estándar C2PA): Funciona como un pasaporte digital que indica quién creó el contenido y qué herramientas se usaron.

- Marcas de agua e Huellas digitales: Señales técnicas, a veces imperceptibles, que ayudan a verificar si un archivo ha sido modificado.

- Vínculo de seguridad: Al unir la procedencia con marcas de agua, se genera un nivel de confianza superior para el usuario final.

3. Las trampas del sistema: Ataques sociotécnicos

Uno de los hallazgos más novedosos del estudio es el concepto de ataques sociotécnicos. No siempre se trata de crear algo falso, sino de manipular la verificación para engañar al público.

Ejemplo: Alguien podría realizar una edición minúscula e irrelevante en una foto real de un evento masivo. Los sistemas actuales marcarían la imagen como “manipulada”, permitiendo que voces malintencionadas aleguen que todo el evento fue un fraude, cuando la esencia de la foto era verdadera.

4. ¿Por qué es tan difícil verificar la verdad?

La autenticación es compleja porque no hay una solución universal.

- Formatos diversos: El audio, el video y el texto tienen limitaciones técnicas muy distintas.

- Privacidad vs. Atribución: Mientras algunos creadores quieren que se reconozca su autoría, otros prefieren no incluir datos personales en la procedencia digital.

- Dispositivos vulnerables: Las cámaras tradicionales (sin conexión) carecen de seguridad integrada, lo que facilita que su información de origen sea alterada.

5. El camino a seguir: Certificar la realidad

A medida que la edición por IA se vuelve una herramienta común y legítima, la procedencia segura será vital para evitar que el público descarte todo contenido como “falso”.

- Para medios y figuras públicas: Certificar sus imágenes les permite demostrar fidelidad ante su audiencia.

- Para gobiernos: Es esencial que los documentos y comunicados oficiales cuenten con sellos de autenticidad indiscutibles.

- Para la industria: Es necesaria una investigación continua para que estas etiquetas de seguridad sean coherentes, fáciles de entender y útiles para el ciudadano común.